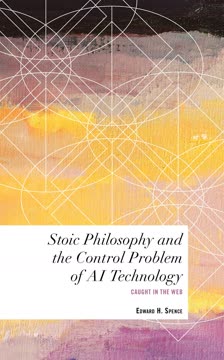

نکات کلیدی

۱. مسئله کنترل: چه کسی بر فناوری مسلط است — ما یا هوش مصنوعی؟

«اگر هدف نادرستی را در ماشینی که از ما هوشمندتر است قرار دهیم، آن هدف را محقق خواهد کرد و ما بازنده خواهیم بود.»

دشواری اصلی. با پیشرفت روزافزون سیستمهای هوش مصنوعی، پرسشی بنیادین مطرح میشود: آیا انسانها کنترل را حفظ خواهند کرد یا هوش مصنوعی در نهایت بر ما غلبه خواهد یافت؟ این «مسئله کنترل» تنها مربوط به تواناییهای فناوری نیست، بلکه درباره همراستایی اهداف هوش مصنوعی با ارزشها و منافع انسانی است.

خطر وجودی. برخی متخصصان هشدار میدهند که هوش مصنوعی فوقالعاده هوشمند میتواند تهدیدی وجودی برای بشریت باشد، اگر به درستی کنترل و با اهداف ما همراستا نشود. چالش اصلی در این است که با افزایش قدرت هوش مصنوعی، آن همچنان به نفع انسانها عمل کند و اهداف مضر خود را دنبال نکند.

نگرانیهای کنونی. حتی در هوش مصنوعی محدود نیز مشکلات کنترل دیده میشود:

- الگوریتمهای شبکههای اجتماعی که رفتار کاربران را دستکاری میکنند

- سیستمهای تصمیمگیری خودکار که تعصبات را تداوم میبخشند

- نظارت مبتنی بر هوش مصنوعی که حریم خصوصی را تضعیف میکند

- نبود شفافیت در فرایندهای تصمیمگیری هوش مصنوعی

۲. فلسفه رواقی چارچوبی برای حل مسئله کنترل ارائه میدهد

«حکمت، بهعنوان فناوری فرامغزی ذهن، میتواند راهنمای ما در کنترل فناوری و استفاده از آن برای خیر مشترک باشد.»

حکمت باستانی برای چالشهای مدرن. فلسفه رواقی با تأکید بر خودکنترلی عقلانی و فضیلت، دیدگاههای ارزشمندی برای مواجهه با چالشهای اخلاقی هوش مصنوعی ارائه میدهد. تمرکز رواقیان بر کنترل ذهن و رفتار خود به جای شرایط بیرونی، بسیار مرتبط است.

اصول کلیدی رواقی در هوش مصنوعی:

- تمرکز بر آنچه در کنترل ماست (انتخابها و قضاوتهایمان)

- پیگیری فضیلت و حکمت بهعنوان عالیترین ارزشها

- زندگی در هماهنگی با طبیعت و عقل

- پذیرش دیدگاه جهانشهری نسبت به انسانیت

کاربرد عملی. اصول رواقی میتوانند توسعه و تنظیم هوش مصنوعی را هدایت کنند از طریق:

- تأکید بر اختیار و خودمختاری انسانی در طراحی هوش مصنوعی

- ترویج تصمیمگیری اخلاقی در سیستمهای هوش مصنوعی

- تشویق رویکردی جهانی و مشارکتی در حاکمیت هوش مصنوعی

- پرورش حکمت و فضیلت در میان فناوران و سیاستگذاران

۳. استفاده شرکتهای بزرگ فناوری از الگوریتمهای هوش مصنوعی، خودمختاری و رفاه انسان را تهدید میکند

«مشکل، پولیسازی و تسلیح اطلاعات کاربران است که به گوگل قدرت و کنترل عظیمی برای تأثیرگذاری بر همه جنبههای زندگی ما میدهد.»

اقتصاد توجه. شرکتهای بزرگ فناوری مانند فیسبوک و گوگل مدلهای کسبوکار خود را بر اساس جذب و پولیسازی توجه کاربران با الگوریتمهای هوش مصنوعی بنا کردهاند. این موضوع تعارض منافع بین رفاه کاربران و سود شرکتها ایجاد میکند.

دستکاری و اعتیاد. الگوریتمهای هوش مصنوعی برای حداکثر کردن تعامل طراحی شدهاند و اغلب از آسیبپذیریهای روانی بهره میبرند تا کاربران را بیشتر در پلتفرمها نگه دارند. این میتواند منجر به:

- رفتارهای اعتیادگونه

- گسترش اطلاعات نادرست و قطبیسازی

- تضعیف حریم خصوصی و سوءاستفاده از دادهها

- تضعیف خودمختاری و تصمیمگیری فردی

عدم توازن قدرت. دادهها و توانمندیهای هوش مصنوعی شرکتهای بزرگ، نابرابری قدرت بیسابقهای بین شرکتها و افراد ایجاد کرده که تهدیدی برای فرآیندهای دموکراتیک و آزادیهای شخصی است.

۴. مسئله همراستایی اهداف: تضمین اینکه هوش مصنوعی اهداف انسانی را دنبال کند

«مسئله همراستایی اهداف هوش مصنوعی سه بخش دارد که هیچکدام حل نشده و هماکنون موضوع تحقیقات فعال است.»

چالشی حیاتی. با پیشرفت هوش مصنوعی، اطمینان از اینکه اهداف آن با ارزشهای انسانی همراستا باشد، اهمیت و دشواری بیشتری مییابد. این «مسئله همراستایی اهداف» در خلق هوش مصنوعی سودمند مرکزی است.

سه جنبه کلیدی:

۱. آموزش هوش مصنوعی برای یادگیری اهداف ما

۲. واداشتن هوش مصنوعی به پذیرش اهداف ما

۳. حفظ اهداف ما توسط هوش مصنوعی با افزایش هوشمندی آن

تحقیقات جاری. پژوهشگران هوش مصنوعی روشهای مختلفی را برای حل این مسئله بررسی میکنند، از جمله:

- یادگیری معکوس تقویتی

- الگوریتمهای یادگیری ارزشها

- چارچوبهای اخلاقی هوش مصنوعی

- مدلهای همکاری انسان و هوش مصنوعی

۵. کرامت و خودمختاری حقوق بنیادین انسان در عصر هوش مصنوعی هستند

«شکل نهایی کنترل، حاکمیت فردی است که بهعنوان مالکیت بر خود، بهویژه بدن، انتخابها و دادههای خود فهمیده میشود.»

حفظ ذات انسانی. با گسترش هوش مصنوعی، حفاظت از کرامت و خودمختاری انسان اهمیت حیاتی مییابد. این مفاهیم پایه حقوق بشر هستند و باید در توسعه و حاکمیت هوش مصنوعی محور قرار گیرند.

جنبههای کلیدی حفاظت:

- حاکمیت بر دادههای شخصی

- آزادی انتخاب و تصمیمگیری

- حفظ حریم خصوصی و کنترل هویت دیجیتال

- نقش فعال انسان در فرایندهای هوش مصنوعی

الزامات اخلاقی. سیستمهای هوش مصنوعی باید به گونهای طراحی شوند که کرامت و خودمختاری انسان را تقویت کنند، نه تضعیف. این مستلزم:

- شفافیت در تصمیمگیری هوش مصنوعی

- پاسخگویی در قبال عملکرد هوش مصنوعی

- کنترل کاربران بر تعاملات با هوش مصنوعی

- احترام به حقوق بشر در کاربردهای هوش مصنوعی

۶. طراحی هوش مصنوعی سودمند مستلزم دربرگیری ارزشها و اخلاق انسانی است

«ماشینها تا حدی سودمندند که اقداماتشان بتواند اهداف ما را محقق کند.»

هوش مصنوعی همراستا با ارزشها. خلق سیستمهای هوش مصنوعی که به نفع بشریت باشند، نیازمند گنجاندن صریح ارزشها و اصول اخلاقی انسانی در طراحی و عملکرد آنهاست. این فراتر از کارکرد صرف است و تأثیر گستردهتر بر افراد و جامعه را در نظر میگیرد.

اصول کلیدی طراحی:

- شفافیت و قابلیت توضیح

- عدالت و عدم تبعیض

- حفاظت از حریم خصوصی

- ایمنی و امنیت

- طراحی انسانمحور

رویکرد میانرشتهای. توسعه هوش مصنوعی سودمند نیازمند همکاری میان:

- پژوهشگران و مهندسان هوش مصنوعی

- اخلاقپژوهان و فیلسوفان

- دانشمندان اجتماعی و روانشناسان

- سیاستگذاران و حقوقدانان

- نمایندگان جوامع متنوع

۷. نیازمند رابطه همزیستی نوینی میان انسان و هوش مصنوعی هستیم

«نتیجه، رابطهای نوین میان انسان و ماشین خواهد بود که امیدوارم بتواند ما را در دهههای آینده بهخوبی هدایت کند.»

تعریف مجدد تعامل انسان و هوش مصنوعی. به جای دیدن هوش مصنوعی بهعنوان تهدید یا جایگزین انسان، باید رابطهای تعاملی و همزیستی پرورش دهیم که در آن هوش مصنوعی تواناییهای انسانی را تقویت و ارتقا دهد.

ویژگیهای کلیدی:

- سیستمهای هوش مصنوعی که به قضاوت انسان احترام میگذارند

- حفظ کنترل معنادار انسان بر تصمیمات هوش مصنوعی

- ارتقای تواناییهای شناختی و خلاقیت انسان توسط هوش مصنوعی

- تقویت نقاط قوت مکمل انسان و هوش مصنوعی

مزایای بالقوه:

- حل چالشهای پیچیده جهانی

- گسترش دانش و کاوش انسانی

- بهبود کیفیت زندگی و رفاه

- پرورش رشد و خودتحققیابی انسان

۸. اقدام جمعی و تغییر فرهنگی برای تنظیم هوش مصنوعی ضروری است

«ما به جنبش فرهنگی نیاز داریم تا ایدهآلها و ترجیحاتمان را به سوی خودمختاری، اختیار و توانمندی و دور از خودخواهی و وابستگی تغییر دهد.»

فراتر از راهحلهای فنی. مواجهه با چالشهای هوش مصنوعی نیازمند نوآوری فناوری نیست، بلکه تغییرات اجتماعی، فرهنگی و سیاسی است. این امر مستلزم اقدام جمعی و تغییر ارزشهای جامعه است.

زمینههای کلیدی تغییر:

- نظامهای آموزشی که سواد دیجیتال و تفکر انتقادی را ترویج میکنند

- چارچوبهای سیاسی و قانونی برای حاکمیت هوش مصنوعی

- پاسخگویی شرکتها در توسعه و بهکارگیری هوش مصنوعی

- گفتوگوی عمومی درباره پیامدهای اخلاقی هوش مصنوعی

همکاری جهانی. ماهیت فراملی هوش مصنوعی همکاری بینالمللی را در زمینههای زیر ضروری میسازد:

- استانداردهای ایمنی و امنیت هوش مصنوعی

- مقررات حفاظت از دادهها

- راهنمای اخلاقی برای پژوهش و توسعه هوش مصنوعی

- سازوکارهای مقابله با ریسکهای جهانی مرتبط با هوش مصنوعی

۹. حکمت و فضیلت کلید تسلط بر فناوریاند، نه صرفاً دانش

«بیش از اطلاعات، حکمت نیازمند تحول است.»

فراتر از انباشت اطلاعات. در عصر دادههای فراوان و بینشهای مبتنی بر هوش مصنوعی، پرورش حکمت اهمیت بیشتری مییابد. حکمت تنها جمعآوری دانش نیست، بلکه شامل قضاوت، اخلاق و توانایی بهکارگیری دانش بهصورت سودمند است.

ویژگیهای حکمت در ارتباط با فناوری:

- تشخیص اخلاقی در انتخابهای فناورانه

- تفکر بلندمدت درباره پیامدها

- تعادل نوآوری با احتیاط

- شناخت محدودیتهای فناوری و ارزشهای انسانی

پرورش فضیلت فناورانه:

- توسعه خودکنترلی و میانهروی دیجیتال

- استفاده آگاهانه و هدفمند از فناوری

- تقویت همدلی و ارتباط انسانی در فضای دیجیتال

- پیگیری یادگیری و سازگاری مستمر

۱۰. فناوری باید در خدمت رفاه بشریت باشد، نه منافع شرکتی

«زیرا در غیاب هرگونه منفعت ملموس یا بالقوه اودایمونیک برای جامعه و رفاه جمعی ما، فناوری به چه کار میآید؟»

بازتعریف پیشرفت فناوری. هدف نهایی فناوری، از جمله هوش مصنوعی، باید ارتقای رفاه و شکوفایی انسانی (اودایمونیا) باشد، نه صرفاً کسب سود یا پیشرفت فنی.

ملاحظات کلیدی:

- اولویت دادن به منفعت اجتماعی بر سود شرکتی

- ارزیابی تأثیر فناوری بر رفاه فردی و جمعی

- توسعه معیارهایی برای سنجش ارزش اودایمونیک فناوری

- تشویق نوآوری مسئولانه همراستا با ارزشهای انسانی

گامهای عملی:

- گنجاندن ارزیابی رفاه در توسعه فناوری

- تنظیم هوش مصنوعی و استفاده از دادهها برای حفاظت از منافع عمومی

- توانمندسازی کاربران در کنترل تجربیات دیجیتال خود

- ترویج نوآوری فناورانه با هدف حل چالشهای جهانی