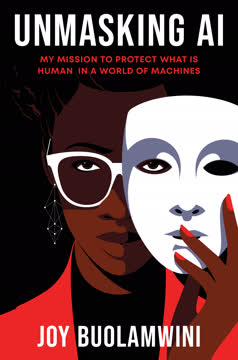

핵심 요약

1. 코드된 시선: AI 시스템의 편향성 드러내기

"기본값은 중립적이지 않다. 그것들은 종종 코드된 시선을 반영한다—어떤 주제에 집중할지 선택할 권한을 가진 사람들의 선호를."

코드된 시선은 기술을 창조하는 사람들의 우선순위, 선호, 편견이 차별과 삭제를 통해 해를 끼칠 수 있는 방식을 의미한다. 조이 부올라미니는 MIT에서 얼굴 인식 프로젝트를 진행하던 중, 시스템이 자신의 얼굴을 인식하기 위해 흰색 마스크를 써야 했던 경험을 통해 이 개념을 발견했다. 이 경험은 그녀가 AI 시스템, 특히 얼굴 인식 기술의 편향성을 조사하게 만들었다.

주요 발견:

- AI 시스템은 어두운 피부색을 가진 사람들과 여성에게 종종 성능이 저조하다

- AI 모델을 훈련시키는 데 사용되는 벤치마크 데이터셋은 종종 밝은 피부색을 가진 남성에게 치우쳐 있다

- 이러한 편향성은 잘못된 체포부터 기회 박탈에 이르기까지 현실 세계에 영향을 미칠 수 있다

부올라미니의 연구는 주요 기술 회사들의 얼굴 분석 시스템이 피부색과 성별에 따라 최대 34.4%의 오류율 차이를 보이는 등 상당한 정확도 격차가 있음을 밝혀냈다.

2. 예술 프로젝트에서 글로벌 운동으로: 알고리즘 정의 연맹의 탄생

"나는 물러서지 않을 것이다. 대학원생이 기술 대기업에 맞서는 것은 일반적인 길이 아니었지만, 기계에 의해 인식되기 위해 백인 얼굴로 코딩하는 것도 마찬가지였다."

**알고리즘 정의 연맹(AJL)**은 부올라미니의 MIT 석사 논문 프로젝트에서 시작되었다. 얼굴 인식 기술의 한계를 탐구하는 예술 설치물로 시작된 이 프로젝트는 알고리즘 책임성과 정의를 위한 글로벌 운동으로 발전했다.

AJL의 사명:

- AI 편향성의 영향에 대한 인식 제고

- 더 포괄적이고 공정한 AI 시스템을 옹호

- AI 시스템의 편향성을 감사하기 위한 도구와 방법론 개발

- 정책 입안자 및 업계 리더와 협력하여 책임 있는 AI 개발 촉진

이 조직의 활동은 정책 결정, 기업 관행, AI 윤리에 대한 공공 담론에 영향을 미쳤으며, 학술 연구와 활동, 예술을 결합한 힘을 보여주었다.

3. 알고리즘 감사: 상업용 AI 제품의 결함 드러내기

"내 수업 프로젝트가 나에게 작동하지 않았다고? 내 밝은 피부색의 동급생들은 그것을 사용하는 것을 즐기는 것 같았다. 물론, 카메라가 개인을 추적하는 결과와 대규모 감시의 위험을 고려할 때 얼굴이 인식되지 않는 것이 이점이 될 수도 있다."

알고리즘 감사는 AI 시스템을 체계적으로 평가하여 다양한 인구 집단 간의 편향성과 성능 격차를 식별하는 것이다. 부올라미니의 "젠더 쉐이즈" 프로젝트는 상업용 성별 분류 시스템에서 상당한 정확도 격차를 드러낸 획기적인 알고리즘 감사였다.

젠더 쉐이즈 감사의 주요 발견:

- 테스트된 모든 시스템이 어두운 피부색을 가진 여성에게 가장 성능이 저조했다

- 가장 큰 정확도 격차는 밝은 피부색 남성과 어두운 피부색 여성 간의 34.4%였다

- 감사는 주요 기술 회사들의 AI 제품에도 상당한 편향성이 있음을 밝혀냈다

젠더 쉐이즈 프로젝트와 후속 감사는 상업용 AI 시스템의 개선과 다양한 테스트 데이터셋과 엄격한 평가 방법의 필요성에 대한 인식을 높였다.

4. 감성적 감사의 힘: AI의 영향을 인간화하기

"기계가 내가 보는 여왕들을 볼 수 있을까? 기계가 우리가 알던 할머니들을 볼 수 있을까?"

감성적 감사는 예술적 표현과 개인적인 이야기를 사용하여 알고리즘 편향의 인간적 영향을 보여준다. 부올라미니의 시 낭송 작품 "AI, Ain't I A Woman?"은 AI 시스템이 저명한 흑인 여성들의 이미지를 잘못 분류하는 방식을 보여주는 대표적인 예이다.

감성적 감사의 영향:

- AI 편향의 결과를 인간화

- 학술적 범위를 넘어 더 넓은 청중에게 도달

- 행동과 정책 변화를 영감

"AI, Ain't I A Woman?" 비디오는 바이럴이 되었고 다큐멘터리 "Coded Bias"에 소개되어 AI 편향과 그 현실적 의미에 대한 대중의 인식을 높이는 데 기여했다.

5. 삭제와의 싸움: 기술에서 소외된 목소리 증폭하기

"내 발견에 대해 침묵하는 것은 해를 방지하지 못했을 것이다. 왜냐하면 이러한 시스템은 이미 개발 중이었기 때문이다. 내가 목소리를 낸 것은 대안 경로를 고려할 기회를 제공했다, 비록 그것이 사용하지 않는 것을 포함하더라도."

삭제와의 싸움은 AI와 기술에서 소외된 목소리를 적극적으로 증폭하고 현상에 도전하는 것을 포함한다. 부올라미니의 미디어 삭제와 학술적 게이트키핑 경험은 AI 연구 및 개발에서 다양한 관점의 중요성을 강조한다.

삭제와의 싸움을 위한 전략:

- 소외된 연구자 및 실무자와 협력하고 지원

- 미디어 플랫폼을 사용하여 다양한 목소리와 경험을 강조

- 제도와 기업에 체계적 편향성을 해결하도록 도전

부올라미니의 다큐멘터리 "Coded Bias"와 그녀의 옹호 활동은 AI 윤리와 연구에서 여성과 유색인종의 기여에 대한 관심을 높이는 데 기여했다.

6. 학계를 넘어: 정책 입안자 및 대중과의 소통

"의회가 이 문제에 대해 조치를 취할 것이다."

정책 입안자와의 소통은 연구 결과를 현실 세계의 변화로 번역하는 데 중요하다. 부올라미니의 의회 증언과 정부 기관과의 협력은 연구자가 정책 결정에 미칠 수 있는 영향을 보여준다.

주요 정책 참여:

- 얼굴 인식 기술에 대해 의회에서 증언

- AI 권리 장전 개발에 기여

- 법 집행 기관의 얼굴 인식 사용 규제를 지원하는 지역 노력

이러한 노력은 AI 시스템에 대한 감시 강화, 제안된 법안, 다양한 수준의 정부에서의 정책 변화를 이끌어냈다.

7. AI 개발에서의 포함과 배제의 비용

"AI 시스템의 설계 및 배포에서 포함과 배제의 비용을 고려해야 하며, 이는 맥락화되어야 한다."

포함과 배제의 균형은 잠재적 이익과 해를 신중하게 고려해야 한다. 다양한 데이터셋은 AI 성능을 향상시킬 수 있지만, 더 광범위한 감시와 통제를 가능하게 할 수도 있다.

고려 사항:

- AI 정확도 향상은 의료 진단 등 유익한 응용 프로그램을 향상시킬 수 있다

- 더 정확한 얼굴 인식은 대규모 감시를 가능하게 할 수도 있다

- 특정 그룹을 데이터셋에서 제외하면 프라이버시를 보호할 수 있지만, 해당 그룹의 성능 저하로 이어질 수 있다

부올라미니는 기술 성능 지표에만 집중하지 않고 AI 시스템의 더 넓은 사회적 함의를 고려하는 신중한 접근을 옹호한다.

8. 알고리즘 정의를 향하여: 연구에서 현실 세계의 변화로

"우리는 법이 필요하다. 수년간 알고리즘 책임성, 원격 생체 인식 기술, 데이터 프라이버시에 대한 법안이 도입되었다. AI가 우리의 삶에 미치는 영향에 대한 인식이 높아짐에 따라, 기술이 어떻게 발전하든 우리의 시민권을 보호할 정부 기관이 필요하다."

알고리즘 정의는 연구, 옹호, 정책 변화, 대중 참여를 결합한 다각적인 접근이 필요하다. 부올라미니의 대학원생에서 영향력 있는 AI 윤리학자로의 여정은 개인이 체계적 변화를 이끌 수 있는 잠재력을 보여준다.

알고리즘 정의를 위한 주요 요소:

- AI 시스템의 엄격한 연구 및 감사

- 대중 교육 및 인식 캠페인

- 정책 입안자 및 업계 리더와의 협력

- 풀뿌리 노력 및 커뮤니티 조직 지원

AI 권리 장전의 발표와 AI 윤리 문제에 대한 대중의 인식 증가는 진전을 보여주지만, AI 시스템이 인권을 존중하고 공평성을 촉진하는 방식으로 개발되고 배포되도록 하기 위해 지속적인 감시와 옹호가 필요하다.

리뷰 요약

Unmasking AI는 AI 편향성과 윤리에 대한 접근 가능한 탐구로 찬사를 받고 있다. 독자들은 Buolamwini의 개인적인 여정과 기술 세계에 대한 통찰을 높이 평가한다. 많은 이들이 이 책을 정보가 풍부하고 생각을 자극하는 것으로 여기며, 알고리즘 편향성을 다루는 것의 중요성을 강조한다. 일부 리뷰어들은 회고록 같은 스타일을 언급하며 더 많은 기술적 깊이를 원한다고 말한다. 전반적으로, 이 책은 AI의 사회적 영향을 이해하는 데 중요한 기여를 하는 것으로 여겨지지만, 개인 서사와 기술적 내용의 균형에 대한 의견은 다양하다.

다른 독자들이 읽은 책

자주 묻는 질문

What's Unmasking AI about?

- Exploration of AI and Society: Unmasking AI by Joy Buolamwini examines the intersection of artificial intelligence and social justice, focusing on how AI can perpetuate biases and discrimination.

- Personal Narrative: The book combines Buolamwini's personal experiences with rigorous research, detailing her journey as a researcher and activist in the field of algorithmic justice.

- Coded Gaze Concept: A central theme is the "coded gaze," which refers to how the biases of technology creators can be embedded in AI systems, leading to harmful outcomes.

- Call to Action: Buolamwini emphasizes the need for collective action to ensure AI serves humanity equitably, advocating for algorithmic justice and diverse representation in tech development.

Why should I read Unmasking AI?

- Timely and Relevant Topic: As AI technologies become more integrated into daily life, understanding their implications is crucial. Buolamwini's insights provide a necessary critique of these systems.

- Personal and Engaging Narrative: The book combines storytelling with research, making complex topics accessible. Buolamwini's journey offers inspiration and motivation for readers.

- Empowerment Through Knowledge: Reading this book equips individuals with the knowledge to question and challenge the status quo in technology, encouraging critical thinking about societal structures.

- Insightful Perspective: It provides a unique viewpoint from a leading voice in algorithmic justice, essential for anyone interested in technology's impact on society.

What are the key takeaways of Unmasking AI?

- AI Reflects Human Bias: AI systems are not neutral; they reflect the biases of their creators, leading to real-world consequences for marginalized groups.

- Importance of Diverse Representation: Buolamwini argues for the necessity of diverse voices in technology development to ensure AI serves all communities fairly.

- Call to Action: The book urges readers to engage in conversations about AI and its societal impacts, advocating for algorithmic justice and shaping the future of technology.

- Collective Action for Change: Buolamwini emphasizes the need for a united front against harmful AI practices, encouraging participation in movements for algorithmic justice.

What are the best quotes from Unmasking AI and what do they mean?

- "The coded gaze describes the ways...": This quote highlights how biases can be embedded in AI systems, leading to discrimination against marginalized groups.

- "We cannot have racial justice...": It underscores the urgent need for ethical considerations in AI development, particularly in sensitive areas like law enforcement.

- "AI will not solve poverty...": Buolamwini emphasizes that technological solutions cannot address systemic societal issues without addressing underlying social and economic structures.

- "Your silence will not protect you.": This quote underscores the importance of speaking out against injustices, particularly in the context of AI and technology.

How does Joy Buolamwini define the "coded gaze" in Unmasking AI?

- Definition of Coded Gaze: The "coded gaze" is how technology reflects the biases of its creators, leading to harmful outcomes for marginalized communities.

- Examples of Coded Gaze: Buolamwini shares personal anecdotes, such as her experience with facial recognition technology that failed to recognize her dark-skinned face.

- Broader Implications: The concept extends beyond race and gender, encompassing various forms of discrimination, including ableism and ageism.

- Call for Critical Examination: Buolamwini calls for a critical examination of technology to ensure it serves all communities equitably.

What is algorithmic bias, as defined in Unmasking AI?

- Definition of Algorithmic Bias: It refers to the systematic and unfair discrimination that occurs when AI systems produce different outcomes for different demographic groups.

- Real-World Implications: Buolamwini's research shows how algorithmic bias can lead to misidentification and wrongful arrests, particularly for people of color.

- Need for Accountability: Addressing algorithmic bias requires transparency and accountability from tech companies, with rigorous testing and auditing of AI systems.

- Impact on Society: The book provides examples of how these biases manifest in technologies like facial recognition, affecting marginalized communities disproportionately.

What are the implications of AI technologies on marginalized communities as discussed in Unmasking AI?

- Discrimination in AI Systems: AI technologies, particularly facial recognition, can lead to discrimination against marginalized groups, often misidentifying or not recognizing individuals.

- Real-World Consequences: Instances of AI failures have resulted in wrongful arrests and other serious repercussions for individuals from marginalized communities.

- Need for Ethical AI: Buolamwini advocates for ethical AI systems that prioritize the needs and rights of all individuals, emphasizing inclusive data and diverse representation.

- Urgent Accountability: The book underscores the urgent need for accountability in AI development to prevent discrimination and harm.

How does Unmasking AI address the issue of data collection and representation?

- Critique of Data Practices: Buolamwini critiques data collection practices that prioritize convenience over inclusivity, often lacking representation of diverse populations.

- Importance of Diverse Datasets: The book emphasizes the need for datasets that accurately reflect societal diversity to prevent biased outcomes in AI systems.

- Call for Transparency: Buolamwini urges tech companies to disclose data sourcing and demographics, essential for building trust and accountability in AI technologies.

- Impact on AI Development: Without diverse representation in data, AI systems will continue to perpetuate existing inequalities, highlighting the need for change.

How does Joy Buolamwini's work contribute to the fight for algorithmic justice?

- Founding the Algorithmic Justice League: Buolamwini established the organization to raise awareness about AI bias and advocate for equitable technology.

- Research and Activism: Her work combines academic research with grassroots activism, making her a prominent figure in the movement for algorithmic justice.

- Influencing Policy: Buolamwini's advocacy has led to significant discussions around AI regulation, including calls for moratoriums on facial recognition use by law enforcement.

- Community Engagement: She emphasizes the importance of community engagement in addressing AI harms, ensuring that affected voices are heard.

What is the significance of the "Gender Shades" project mentioned in Unmasking AI?

- Research on Facial Recognition: The "Gender Shades" project examined facial recognition systems' performance across demographic groups, revealing significant accuracy disparities.

- Impact on Industry Standards: The findings influenced major tech companies to reconsider practices and improve algorithms, prompting discussions about AI ethics.

- Raising Awareness: The project catalyzed broader conversations about representation and bias in AI, highlighting the need for diverse datasets and inclusive practices.

- Influence on Policy: It has served as a foundation for advocating policy changes to address algorithmic bias and ensure ethical AI development.

How does Unmasking AI propose solutions for algorithmic bias?

- Advocacy for Algorithmic Justice: Buolamwini calls for ethical considerations in AI development, encouraging conversations about societal impacts and equitable solutions.

- Diverse Representation in Tech: The book highlights the importance of including diverse voices in technology development to ensure fair AI systems.

- Policy Recommendations: Buolamwini suggests collaboration between policymakers and tech companies to create regulations addressing algorithmic bias.

- Accountability and Transparency: Emphasizes the need for accountability and transparency in AI systems to prevent discrimination and harm.

How can individuals contribute to the movement for algorithmic justice?

- Educate Yourself and Others: Buolamwini encourages learning about AI and its societal impacts, sharing knowledge to build an informed community.

- Advocate for Change: Participate in advocacy efforts, such as supporting legislation addressing AI bias and discrimination, and engage with local organizations.

- Challenge Harmful Practices: Question and challenge AI technologies that perpetuate harm, holding companies accountable for a just technological landscape.

- Empowerment Through Action: Individuals can contribute to a more equitable future by actively participating in movements for algorithmic justice.