Kluczowe wnioski

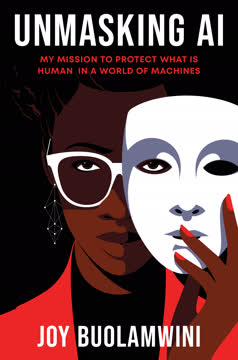

1. Zakodowane spojrzenie: Odkrywanie uprzedzeń w systemach AI

"Domyślne ustawienia nie są neutralne. Często odzwierciedlają zakodowane spojrzenie—preferencje tych, którzy mają władzę decydować, na jakie tematy się skupić."

Zakodowane spojrzenie odnosi się do tego, jak priorytety, preferencje i uprzedzenia twórców technologii mogą propagować szkodę poprzez dyskryminację i wymazywanie. Joy Buolamwini odkryła to pojęcie podczas pracy nad projektem rozpoznawania twarzy w MIT, gdzie musiała nosić białą maskę, aby system mógł wykryć jej twarz. To doświadczenie skłoniło ją do zbadania uprzedzeń w systemach AI, szczególnie w technologiach rozpoznawania twarzy.

Kluczowe odkrycia:

- Systemy AI często działają gorzej na osobach o ciemniejszej skórze i kobietach

- Zbiory danych używane do trenowania modeli AI są często przechylone w stronę mężczyzn o jaśniejszej skórze

- Te uprzedzenia mogą prowadzić do rzeczywistych konsekwencji, od fałszywych aresztowań po odmowę szans

Badania Buolamwini wykazały, że systemy analizy twarzy dużych firm technologicznych miały znaczące różnice w dokładności w zależności od typu skóry i płci, z błędami sięgającymi 34,4% między mężczyznami o jaśniejszej skórze a kobietami o ciemniejszej skórze.

2. Od projektu artystycznego do globalnego ruchu: Narodziny Algorithmic Justice League

"Nie zamierzałam się powstrzymywać. Studentka magisterium stawiająca czoła gigantycznym firmom technologicznym nie była typową ścieżką, ale kodowanie w białej masce, aby być widoczną dla maszyny, również nie było typowe."

Algorithmic Justice League (AJL) wyłoniła się z projektu pracy magisterskiej Buolamwini w MIT. To, co zaczęło się jako instalacja artystyczna badająca ograniczenia technologii rozpoznawania twarzy, przekształciło się w globalny ruch na rzecz odpowiedzialności i sprawiedliwości algorytmicznej.

Misja AJL:

- Podnoszenie świadomości na temat wpływu uprzedzeń AI

- Działanie na rzecz bardziej inkluzywnych i sprawiedliwych systemów AI

- Opracowywanie narzędzi i metodologii do audytowania systemów AI pod kątem uprzedzeń

- Współpraca z decydentami i liderami branży w celu promowania odpowiedzialnego rozwoju AI

Praca organizacji wpłynęła na decyzje polityczne, praktyki korporacyjne i dyskurs publiczny na temat etyki AI, pokazując siłę łączenia badań akademickich z aktywizmem i sztuką.

3. Audyty algorytmiczne: Ujawnianie wad komercyjnych produktów AI

"Nawet jeśli mój projekt klasowy nie działał na mnie? Moi koledzy o jaśniejszej skórze zdawali się cieszyć z jego używania. I oczywiście, mogło być pewną zaletą, że twarz nie była wykrywana, biorąc pod uwagę konsekwencje śledzenia osób przez kamery i niebezpieczeństwa masowej inwigilacji."

Audyty algorytmiczne to systematyczne oceny systemów AI mające na celu identyfikację uprzedzeń i różnic w wydajności w różnych grupach demograficznych. Projekt Buolamwini "Gender Shades" był przełomowym audytem algorytmicznym, który ujawnił znaczące luki w dokładności komercyjnych systemów klasyfikacji płci.

Kluczowe odkrycia audytu Gender Shades:

- Wszystkie testowane systemy działały najgorzej na kobietach o ciemniejszej skórze

- Największa różnica w dokładności wynosiła 34,4% między mężczyznami o jaśniejszej skórze a kobietami o ciemniejszej skórze

- Audyt ujawnił, że nawet produkty AI wiodących firm technologicznych miały znaczne uprzedzenia

Projekt Gender Shades i kolejne audyty doprowadziły do poprawy komercyjnych systemów AI i zwiększenia świadomości na temat potrzeby różnorodnych zbiorów testowych i rygorystycznych metod oceny.

4. Siła sugestywnych audytów: Humanizacja wpływu AI

"Czy maszyny kiedykolwiek zobaczą moje królowe tak, jak ja je widzę? Czy maszyny kiedykolwiek zobaczą nasze babcie tak, jak je znałyśmy?"

Sugestywne audyty wykorzystują wyraz artystyczny i osobiste narracje, aby zilustrować ludzki wpływ uprzedzeń algorytmicznych. Utwór mówiony Buolamwini "AI, Ain't I A Woman?" jest doskonałym przykładem, pokazującym, jak systemy AI błędnie klasyfikowały obrazy wybitnych czarnoskórych kobiet.

Wpływ sugestywnych audytów:

- Humanizowanie konsekwencji uprzedzeń AI

- Docieranie do szerszej publiczności poza kręgi akademickie

- Inspirowanie do działania i zmiany polityki

Film "AI, Ain't I A Woman?" stał się wiralem i został przedstawiony w dokumencie "Coded Bias", pomagając zwiększyć świadomość publiczną na temat uprzedzeń AI i ich rzeczywistych implikacji.

5. Walka z wymazywaniem: Wzmacnianie marginalizowanych głosów w technologii

"Milczenie na temat moich odkryć nie zapobiegłoby szkodom, ponieważ te systemy były już w fazie rozwoju. Moje wypowiedzi dały możliwość rozważenia alternatywnych ścieżek, w tym nieużywania."

Walka z wymazywaniem w AI i technologii polega na aktywnym wzmacnianiu marginalizowanych głosów i kwestionowaniu status quo. Doświadczenia Buolamwini z wymazywaniem medialnym i akademickim podkreślają znaczenie różnorodnych perspektyw w badaniach i rozwoju AI.

Strategie walki z wymazywaniem:

- Współpraca z i wspieranie niedoreprezentowanych badaczy i praktyków

- Wykorzystywanie platform medialnych do podkreślania różnorodnych głosów i doświadczeń

- Kwestionowanie instytucji i firm w celu rozwiązania systemowych uprzedzeń

Praca Buolamwini z dokumentem "Coded Bias" i jej działania na rzecz rzecznictwa pomogły zwrócić uwagę na wkład kobiet i osób kolorowych w etykę i badania AI.

6. Poza akademią: Angażowanie decydentów i społeczeństwa

"Kongres coś z tym zrobi."

Angażowanie się z decydentami jest kluczowe dla przekształcania wyników badań w rzeczywiste zmiany. Zeznania Buolamwini przed Kongresem i praca z agencjami rządowymi pokazują, jaki wpływ mogą mieć badacze na decyzje polityczne.

Kluczowe zaangażowania polityczne:

- Zeznania przed Kongresem na temat technologii rozpoznawania twarzy

- Wkład w rozwój Karty Praw AI

- Wsparcie lokalnych działań na rzecz regulacji użycia rozpoznawania twarzy przez organy ścigania

Te działania doprowadziły do zwiększonej kontroli systemów AI, proponowanych ustaw i zmian polityki na różnych szczeblach rządu.

7. Koszty inkluzji i wykluczenia w rozwoju AI

"Należy rozważyć koszty inkluzji i wykluczenia w projektowaniu i wdrażaniu systemów AI, które muszą być kontekstualizowane."

Równoważenie inkluzji i wykluczenia w rozwoju AI wymaga starannego rozważenia potencjalnych korzyści i szkód. Chociaż różnorodne zbiory danych mogą poprawić wydajność AI, mogą również umożliwić bardziej wszechobecną inwigilację i kontrolę.

Rozważania:

- Poprawa dokładności AI może zwiększyć korzystne zastosowania (np. diagnostyka medyczna)

- Bardziej dokładne rozpoznawanie twarzy może również umożliwić masową inwigilację

- Wykluczenie niektórych grup ze zbiorów danych może chronić prywatność, ale prowadzić do gorszej wydajności dla tych grup

Buolamwini opowiada się za zniuansowanym podejściem, które uwzględnia szersze implikacje społeczne systemów AI, zamiast skupiać się wyłącznie na technicznych wskaźnikach wydajności.

8. W kierunku sprawiedliwości algorytmicznej: Od badań do rzeczywistych zmian

"Potrzebujemy praw. Przez lata wprowadzano projekty ustaw dotyczących odpowiedzialności algorytmicznej, zdalnych technologii biometrycznych i prywatności danych. Wraz z rosnącą świadomością na temat wpływu AI na nasze życie, musimy wiedzieć, że nasze instytucje rządowe będą chronić nasze prawa obywatelskie, niezależnie od tego, jak technologia się rozwija."

Sprawiedliwość algorytmiczna wymaga wieloaspektowego podejścia łączącego badania, rzecznictwo, zmiany polityki i zaangażowanie społeczne. Droga Buolamwini od studentki magisterium do wpływowej etyczki AI ilustruje potencjał jednostek do napędzania systemowych zmian.

Kluczowe elementy walki o sprawiedliwość algorytmiczną:

- Rygorystyczne badania i audyty systemów AI

- Kampanie edukacyjne i podnoszące świadomość publiczną

- Współpraca z decydentami i liderami branży

- Wsparcie dla oddolnych działań i organizacji społecznych

Wydanie Karty Praw AI i rosnąca świadomość publiczna na temat kwestii etyki AI pokazują postęp, ale konieczna jest ciągła czujność i rzecznictwo, aby zapewnić, że systemy AI są rozwijane i wdrażane w sposób szanujący prawa człowieka i promujący równość.

Podsumowanie recenzji

Demaskowanie AI jest chwalone za przystępne omówienie uprzedzeń i etyki w sztucznej inteligencji. Czytelnicy doceniają osobistą podróż Buolamwini oraz jej wgląd w świat technologii. Wielu uważa książkę za pouczającą i skłaniającą do refleksji, podkreślając znaczenie zajmowania się uprzedzeniami algorytmicznymi. Niektórzy recenzenci zwracają uwagę na styl przypominający pamiętnik i życzą sobie większej głębi technicznej. Ogólnie rzecz biorąc, książka jest postrzegana jako istotny wkład w zrozumienie społecznego wpływu AI, choć opinie na temat równowagi między narracją osobistą a treścią techniczną są podzielone.

Inni czytali również

FAQ

What's Unmasking AI about?

- Exploration of AI and Society: Unmasking AI by Joy Buolamwini examines the intersection of artificial intelligence and social justice, focusing on how AI can perpetuate biases and discrimination.

- Personal Narrative: The book combines Buolamwini's personal experiences with rigorous research, detailing her journey as a researcher and activist in the field of algorithmic justice.

- Coded Gaze Concept: A central theme is the "coded gaze," which refers to how the biases of technology creators can be embedded in AI systems, leading to harmful outcomes.

- Call to Action: Buolamwini emphasizes the need for collective action to ensure AI serves humanity equitably, advocating for algorithmic justice and diverse representation in tech development.

Why should I read Unmasking AI?

- Timely and Relevant Topic: As AI technologies become more integrated into daily life, understanding their implications is crucial. Buolamwini's insights provide a necessary critique of these systems.

- Personal and Engaging Narrative: The book combines storytelling with research, making complex topics accessible. Buolamwini's journey offers inspiration and motivation for readers.

- Empowerment Through Knowledge: Reading this book equips individuals with the knowledge to question and challenge the status quo in technology, encouraging critical thinking about societal structures.

- Insightful Perspective: It provides a unique viewpoint from a leading voice in algorithmic justice, essential for anyone interested in technology's impact on society.

What are the key takeaways of Unmasking AI?

- AI Reflects Human Bias: AI systems are not neutral; they reflect the biases of their creators, leading to real-world consequences for marginalized groups.

- Importance of Diverse Representation: Buolamwini argues for the necessity of diverse voices in technology development to ensure AI serves all communities fairly.

- Call to Action: The book urges readers to engage in conversations about AI and its societal impacts, advocating for algorithmic justice and shaping the future of technology.

- Collective Action for Change: Buolamwini emphasizes the need for a united front against harmful AI practices, encouraging participation in movements for algorithmic justice.

What are the best quotes from Unmasking AI and what do they mean?

- "The coded gaze describes the ways...": This quote highlights how biases can be embedded in AI systems, leading to discrimination against marginalized groups.

- "We cannot have racial justice...": It underscores the urgent need for ethical considerations in AI development, particularly in sensitive areas like law enforcement.

- "AI will not solve poverty...": Buolamwini emphasizes that technological solutions cannot address systemic societal issues without addressing underlying social and economic structures.

- "Your silence will not protect you.": This quote underscores the importance of speaking out against injustices, particularly in the context of AI and technology.

How does Joy Buolamwini define the "coded gaze" in Unmasking AI?

- Definition of Coded Gaze: The "coded gaze" is how technology reflects the biases of its creators, leading to harmful outcomes for marginalized communities.

- Examples of Coded Gaze: Buolamwini shares personal anecdotes, such as her experience with facial recognition technology that failed to recognize her dark-skinned face.

- Broader Implications: The concept extends beyond race and gender, encompassing various forms of discrimination, including ableism and ageism.

- Call for Critical Examination: Buolamwini calls for a critical examination of technology to ensure it serves all communities equitably.

What is algorithmic bias, as defined in Unmasking AI?

- Definition of Algorithmic Bias: It refers to the systematic and unfair discrimination that occurs when AI systems produce different outcomes for different demographic groups.

- Real-World Implications: Buolamwini's research shows how algorithmic bias can lead to misidentification and wrongful arrests, particularly for people of color.

- Need for Accountability: Addressing algorithmic bias requires transparency and accountability from tech companies, with rigorous testing and auditing of AI systems.

- Impact on Society: The book provides examples of how these biases manifest in technologies like facial recognition, affecting marginalized communities disproportionately.

What are the implications of AI technologies on marginalized communities as discussed in Unmasking AI?

- Discrimination in AI Systems: AI technologies, particularly facial recognition, can lead to discrimination against marginalized groups, often misidentifying or not recognizing individuals.

- Real-World Consequences: Instances of AI failures have resulted in wrongful arrests and other serious repercussions for individuals from marginalized communities.

- Need for Ethical AI: Buolamwini advocates for ethical AI systems that prioritize the needs and rights of all individuals, emphasizing inclusive data and diverse representation.

- Urgent Accountability: The book underscores the urgent need for accountability in AI development to prevent discrimination and harm.

How does Unmasking AI address the issue of data collection and representation?

- Critique of Data Practices: Buolamwini critiques data collection practices that prioritize convenience over inclusivity, often lacking representation of diverse populations.

- Importance of Diverse Datasets: The book emphasizes the need for datasets that accurately reflect societal diversity to prevent biased outcomes in AI systems.

- Call for Transparency: Buolamwini urges tech companies to disclose data sourcing and demographics, essential for building trust and accountability in AI technologies.

- Impact on AI Development: Without diverse representation in data, AI systems will continue to perpetuate existing inequalities, highlighting the need for change.

How does Joy Buolamwini's work contribute to the fight for algorithmic justice?

- Founding the Algorithmic Justice League: Buolamwini established the organization to raise awareness about AI bias and advocate for equitable technology.

- Research and Activism: Her work combines academic research with grassroots activism, making her a prominent figure in the movement for algorithmic justice.

- Influencing Policy: Buolamwini's advocacy has led to significant discussions around AI regulation, including calls for moratoriums on facial recognition use by law enforcement.

- Community Engagement: She emphasizes the importance of community engagement in addressing AI harms, ensuring that affected voices are heard.

What is the significance of the "Gender Shades" project mentioned in Unmasking AI?

- Research on Facial Recognition: The "Gender Shades" project examined facial recognition systems' performance across demographic groups, revealing significant accuracy disparities.

- Impact on Industry Standards: The findings influenced major tech companies to reconsider practices and improve algorithms, prompting discussions about AI ethics.

- Raising Awareness: The project catalyzed broader conversations about representation and bias in AI, highlighting the need for diverse datasets and inclusive practices.

- Influence on Policy: It has served as a foundation for advocating policy changes to address algorithmic bias and ensure ethical AI development.

How does Unmasking AI propose solutions for algorithmic bias?

- Advocacy for Algorithmic Justice: Buolamwini calls for ethical considerations in AI development, encouraging conversations about societal impacts and equitable solutions.

- Diverse Representation in Tech: The book highlights the importance of including diverse voices in technology development to ensure fair AI systems.

- Policy Recommendations: Buolamwini suggests collaboration between policymakers and tech companies to create regulations addressing algorithmic bias.

- Accountability and Transparency: Emphasizes the need for accountability and transparency in AI systems to prevent discrimination and harm.

How can individuals contribute to the movement for algorithmic justice?

- Educate Yourself and Others: Buolamwini encourages learning about AI and its societal impacts, sharing knowledge to build an informed community.

- Advocate for Change: Participate in advocacy efforts, such as supporting legislation addressing AI bias and discrimination, and engage with local organizations.

- Challenge Harmful Practices: Question and challenge AI technologies that perpetuate harm, holding companies accountable for a just technological landscape.

- Empowerment Through Action: Individuals can contribute to a more equitable future by actively participating in movements for algorithmic justice.