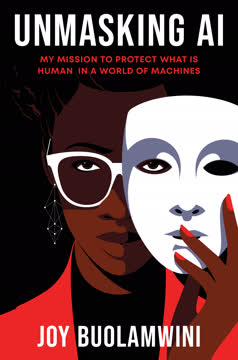

Ключевые идеи

1. Закодированный взгляд: выявление предвзятости в системах ИИ

"Настройки по умолчанию не нейтральны. Они часто отражают закодированный взгляд — предпочтения тех, кто имеет власть выбирать, на какие темы сосредоточиться."

Закодированный взгляд относится к тому, как приоритеты, предпочтения и предубеждения тех, кто создает технологии, могут распространять вред через дискриминацию и стирание. Джой Буоламвини обнаружила эту концепцию, работая над проектом распознавания лиц в MIT, где ей пришлось надеть белую маску, чтобы система могла обнаружить ее лицо. Этот опыт привел ее к исследованию предвзятости в системах ИИ, особенно в технологиях распознавания лиц.

Ключевые выводы:

- Системы ИИ часто плохо работают с людьми с темной кожей и женщинами

- Эталонные наборы данных, используемые для обучения моделей ИИ, часто смещены в сторону мужчин со светлой кожей

- Эти предвзятости могут привести к реальным последствиям, от ложных арестов до отказа в возможностях

Исследования Буоламвини показали, что системы анализа лиц крупных технологических компаний имели значительные различия в точности в зависимости от типа кожи и пола, с ошибками до 34,4% между мужчинами со светлой кожей и женщинами с темной кожей.

2. От арт-проекта к глобальному движению: рождение Лиги алгоритмической справедливости

"Я не собиралась сдерживаться. Аспирантка, выступающая против технологических гигантов, не была типичным путем, но и кодирование в белом гриме, чтобы быть увиденной машиной, тоже не было типичным."

Лига алгоритмической справедливости (AJL) возникла из магистерского проекта Буоламвини в MIT. То, что начиналось как художественная инсталляция, исследующая ограничения технологии распознавания лиц, превратилось в глобальное движение за алгоритмическую подотчетность и справедливость.

Миссия AJL:

- Повышение осведомленности о влиянии предвзятости ИИ

- Пропаганда более инклюзивных и справедливых систем ИИ

- Разработка инструментов и методологий для аудита систем ИИ на предмет предвзятости

- Взаимодействие с политиками и лидерами отрасли для продвижения ответственной разработки ИИ

Работа организации повлияла на политические решения, корпоративные практики и общественные дискуссии об этике ИИ, демонстрируя силу сочетания академических исследований с активизмом и искусством.

3. Алгоритмические аудиты: выявление недостатков в коммерческих продуктах ИИ

"Даже если мой классный проект не работал на мне? Моим светлокожим одноклассникам, казалось, нравилось его использовать. И, конечно, может быть преимущество в том, чтобы не быть обнаруженным машиной, учитывая последствия отслеживания камер и опасности массового наблюдения."

Алгоритмические аудиты — это систематические оценки систем ИИ для выявления предвзятостей и различий в производительности среди различных демографических групп. Проект Буоламвини "Gender Shades" был новаторским алгоритмическим аудитом, который выявил значительные пробелы в точности коммерческих систем классификации по полу.

Ключевые выводы аудита Gender Shades:

- Все протестированные системы показали худшие результаты на женщинах с темной кожей

- Наибольший разрыв в точности составил 34,4% между мужчинами со светлой кожей и женщинами с темной кожей

- Аудит показал, что даже продукты ИИ ведущих технологических компаний имели значительные предвзятости

Проект Gender Shades и последующие аудиты привели к улучшению коммерческих систем ИИ и повысили осведомленность о необходимости разнообразных тестовых наборов данных и строгих методов оценки.

4. Сила выразительных аудитов: очеловечивание влияния ИИ

"Могут ли машины когда-нибудь видеть моих королев так, как вижу их я? Могут ли машины когда-нибудь видеть наших бабушек так, как знали их мы?"

Выразительные аудиты используют художественное выражение и личные рассказы, чтобы иллюстрировать человеческое влияние алгоритмической предвзятости. Произведение Буоламвини "AI, Ain't I A Woman?" является ярким примером, демонстрируя, как системы ИИ неправильно классифицировали изображения известных чернокожих женщин.

Влияние выразительных аудитов:

- Очеловечивание последствий предвзятости ИИ

- Достижение более широкой аудитории за пределами академических кругов

- Вдохновение на действия и изменения в политике

Видео "AI, Ain't I A Woman?" стало вирусным и было показано в документальном фильме "Coded Bias", помогая повысить общественную осведомленность о предвзятости ИИ и ее реальных последствиях.

5. Борьба с стиранием: усиление голосов маргинализированных групп в технологиях

"Молчание о моих находках не предотвратило бы вред, потому что эти системы уже разрабатывались. Мое выступление предоставило возможность рассмотреть альтернативные пути, включая неиспользование."

Борьба с стиранием в ИИ и технологиях включает активное усиление голосов маргинализированных групп и вызов статус-кво. Опыт Буоламвини с медийным стиранием и академическими барьерами подчеркивает важность разнообразных перспектив в исследованиях и разработке ИИ.

Стратегии борьбы с стиранием:

- Сотрудничество с и поддержка недопредставленных исследователей и практиков

- Использование медийных платформ для выделения разнообразных голосов и опыта

- Вызов институциям и компаниям для устранения системных предвзятостей

Работа Буоламвини с документальным фильмом "Coded Bias" и ее адвокационные усилия помогли привлечь внимание к вкладу женщин и людей цвета в этику и исследования ИИ.

6. За пределами академии: взаимодействие с политиками и общественностью

"Конгресс что-то сделает по этому поводу."

Взаимодействие с политиками имеет решающее значение для перевода результатов исследований в реальные изменения. Свидетельства Буоламвини перед Конгрессом и работа с государственными учреждениями демонстрируют влияние, которое исследователи могут оказать на политические решения.

Ключевые взаимодействия с политиками:

- Свидетельствовала перед Конгрессом о технологии распознавания лиц

- Внесла вклад в разработку Билля о правах ИИ

- Поддержала местные усилия по регулированию использования распознавания лиц правоохранительными органами

Эти усилия привели к усилению контроля за системами ИИ, предложению законодательства и изменениям в политике на различных уровнях правительства.

7. Стоимость включения и исключения в разработке ИИ

"Необходимо учитывать стоимость включения и исключения при разработке и развертывании систем ИИ, которые должны быть контекстуализированы."

Балансировка включения и исключения в разработке ИИ требует тщательного рассмотрения потенциальных выгод и вреда. Хотя разнообразные наборы данных могут улучшить производительность ИИ, они также могут способствовать более повсеместному наблюдению и контролю.

Соображения:

- Улучшение точности ИИ может повысить полезные приложения (например, медицинская диагностика)

- Более точное распознавание лиц также может способствовать массовому наблюдению

- Исключение определенных групп из наборов данных может защитить конфиденциальность, но привести к снижению производительности для этих групп

Буоламвини выступает за нюансированный подход, который учитывает более широкие социальные последствия систем ИИ, а не только технические показатели производительности.

8. К алгоритмической справедливости: от исследований к реальным изменениям

"Нам нужны законы. За эти годы были предложены проекты законов об алгоритмической подотчетности, удаленных биометрических технологиях и конфиденциальности данных. С ростом осведомленности о влиянии ИИ на нашу жизнь, нам нужно знать, что наши государственные учреждения будут защищать наши гражданские права независимо от того, как развивается технология."

Алгоритмическая справедливость требует многогранного подхода, сочетающего исследования, адвокацию, изменения в политике и общественное участие. Путь Буоламвини от аспирантки до влиятельного этика ИИ иллюстрирует потенциал отдельных лиц для привнесения системных изменений.

Ключевые компоненты борьбы за алгоритмическую справедливость:

- Строгие исследования и аудиты систем ИИ

- Образовательные и просветительские кампании

- Сотрудничество с политиками и лидерами отрасли

- Поддержка инициатив на местах и общественной организации

Выпуск Билля о правах ИИ и растущая общественная осведомленность о вопросах этики ИИ демонстрируют прогресс, но необходимы постоянная бдительность и адвокация, чтобы гарантировать, что системы ИИ разрабатываются и внедряются с уважением к правам человека и продвижением справедливости.

Обзор отзывов

Разоблачение ИИ заслуживает похвалы за доступное исследование предвзятости и этики искусственного интеллекта. Читатели ценят личное путешествие Буоламвини и её взгляды на мир технологий. Многие находят книгу информативной и заставляющей задуматься, подчеркивая важность решения проблемы алгоритмической предвзятости. Некоторые рецензенты отмечают мемуарный стиль и желают большего технического углубления. В целом, книга рассматривается как важный вклад в понимание общественного влияния ИИ, хотя мнения о балансе между личным повествованием и техническим содержанием разнятся.

Читают также

Частые вопросы

What's Unmasking AI about?

- Exploration of AI and Society: Unmasking AI by Joy Buolamwini examines the intersection of artificial intelligence and social justice, focusing on how AI can perpetuate biases and discrimination.

- Personal Narrative: The book combines Buolamwini's personal experiences with rigorous research, detailing her journey as a researcher and activist in the field of algorithmic justice.

- Coded Gaze Concept: A central theme is the "coded gaze," which refers to how the biases of technology creators can be embedded in AI systems, leading to harmful outcomes.

- Call to Action: Buolamwini emphasizes the need for collective action to ensure AI serves humanity equitably, advocating for algorithmic justice and diverse representation in tech development.

Why should I read Unmasking AI?

- Timely and Relevant Topic: As AI technologies become more integrated into daily life, understanding their implications is crucial. Buolamwini's insights provide a necessary critique of these systems.

- Personal and Engaging Narrative: The book combines storytelling with research, making complex topics accessible. Buolamwini's journey offers inspiration and motivation for readers.

- Empowerment Through Knowledge: Reading this book equips individuals with the knowledge to question and challenge the status quo in technology, encouraging critical thinking about societal structures.

- Insightful Perspective: It provides a unique viewpoint from a leading voice in algorithmic justice, essential for anyone interested in technology's impact on society.

What are the key takeaways of Unmasking AI?

- AI Reflects Human Bias: AI systems are not neutral; they reflect the biases of their creators, leading to real-world consequences for marginalized groups.

- Importance of Diverse Representation: Buolamwini argues for the necessity of diverse voices in technology development to ensure AI serves all communities fairly.

- Call to Action: The book urges readers to engage in conversations about AI and its societal impacts, advocating for algorithmic justice and shaping the future of technology.

- Collective Action for Change: Buolamwini emphasizes the need for a united front against harmful AI practices, encouraging participation in movements for algorithmic justice.

What are the best quotes from Unmasking AI and what do they mean?

- "The coded gaze describes the ways...": This quote highlights how biases can be embedded in AI systems, leading to discrimination against marginalized groups.

- "We cannot have racial justice...": It underscores the urgent need for ethical considerations in AI development, particularly in sensitive areas like law enforcement.

- "AI will not solve poverty...": Buolamwini emphasizes that technological solutions cannot address systemic societal issues without addressing underlying social and economic structures.

- "Your silence will not protect you.": This quote underscores the importance of speaking out against injustices, particularly in the context of AI and technology.

How does Joy Buolamwini define the "coded gaze" in Unmasking AI?

- Definition of Coded Gaze: The "coded gaze" is how technology reflects the biases of its creators, leading to harmful outcomes for marginalized communities.

- Examples of Coded Gaze: Buolamwini shares personal anecdotes, such as her experience with facial recognition technology that failed to recognize her dark-skinned face.

- Broader Implications: The concept extends beyond race and gender, encompassing various forms of discrimination, including ableism and ageism.

- Call for Critical Examination: Buolamwini calls for a critical examination of technology to ensure it serves all communities equitably.

What is algorithmic bias, as defined in Unmasking AI?

- Definition of Algorithmic Bias: It refers to the systematic and unfair discrimination that occurs when AI systems produce different outcomes for different demographic groups.

- Real-World Implications: Buolamwini's research shows how algorithmic bias can lead to misidentification and wrongful arrests, particularly for people of color.

- Need for Accountability: Addressing algorithmic bias requires transparency and accountability from tech companies, with rigorous testing and auditing of AI systems.

- Impact on Society: The book provides examples of how these biases manifest in technologies like facial recognition, affecting marginalized communities disproportionately.

What are the implications of AI technologies on marginalized communities as discussed in Unmasking AI?

- Discrimination in AI Systems: AI technologies, particularly facial recognition, can lead to discrimination against marginalized groups, often misidentifying or not recognizing individuals.

- Real-World Consequences: Instances of AI failures have resulted in wrongful arrests and other serious repercussions for individuals from marginalized communities.

- Need for Ethical AI: Buolamwini advocates for ethical AI systems that prioritize the needs and rights of all individuals, emphasizing inclusive data and diverse representation.

- Urgent Accountability: The book underscores the urgent need for accountability in AI development to prevent discrimination and harm.

How does Unmasking AI address the issue of data collection and representation?

- Critique of Data Practices: Buolamwini critiques data collection practices that prioritize convenience over inclusivity, often lacking representation of diverse populations.

- Importance of Diverse Datasets: The book emphasizes the need for datasets that accurately reflect societal diversity to prevent biased outcomes in AI systems.

- Call for Transparency: Buolamwini urges tech companies to disclose data sourcing and demographics, essential for building trust and accountability in AI technologies.

- Impact on AI Development: Without diverse representation in data, AI systems will continue to perpetuate existing inequalities, highlighting the need for change.

How does Joy Buolamwini's work contribute to the fight for algorithmic justice?

- Founding the Algorithmic Justice League: Buolamwini established the organization to raise awareness about AI bias and advocate for equitable technology.

- Research and Activism: Her work combines academic research with grassroots activism, making her a prominent figure in the movement for algorithmic justice.

- Influencing Policy: Buolamwini's advocacy has led to significant discussions around AI regulation, including calls for moratoriums on facial recognition use by law enforcement.

- Community Engagement: She emphasizes the importance of community engagement in addressing AI harms, ensuring that affected voices are heard.

What is the significance of the "Gender Shades" project mentioned in Unmasking AI?

- Research on Facial Recognition: The "Gender Shades" project examined facial recognition systems' performance across demographic groups, revealing significant accuracy disparities.

- Impact on Industry Standards: The findings influenced major tech companies to reconsider practices and improve algorithms, prompting discussions about AI ethics.

- Raising Awareness: The project catalyzed broader conversations about representation and bias in AI, highlighting the need for diverse datasets and inclusive practices.

- Influence on Policy: It has served as a foundation for advocating policy changes to address algorithmic bias and ensure ethical AI development.

How does Unmasking AI propose solutions for algorithmic bias?

- Advocacy for Algorithmic Justice: Buolamwini calls for ethical considerations in AI development, encouraging conversations about societal impacts and equitable solutions.

- Diverse Representation in Tech: The book highlights the importance of including diverse voices in technology development to ensure fair AI systems.

- Policy Recommendations: Buolamwini suggests collaboration between policymakers and tech companies to create regulations addressing algorithmic bias.

- Accountability and Transparency: Emphasizes the need for accountability and transparency in AI systems to prevent discrimination and harm.

How can individuals contribute to the movement for algorithmic justice?

- Educate Yourself and Others: Buolamwini encourages learning about AI and its societal impacts, sharing knowledge to build an informed community.

- Advocate for Change: Participate in advocacy efforts, such as supporting legislation addressing AI bias and discrimination, and engage with local organizations.

- Challenge Harmful Practices: Question and challenge AI technologies that perpetuate harm, holding companies accountable for a just technological landscape.

- Empowerment Through Action: Individuals can contribute to a more equitable future by actively participating in movements for algorithmic justice.