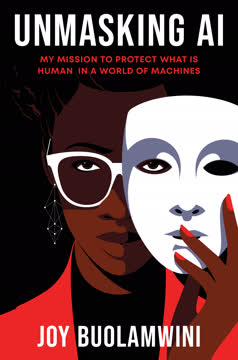

核心要点

1. 编码凝视:揭示AI系统中的偏见

“默认设置并非中立。它们往往反映了编码凝视——那些有权选择关注哪些主题的人的偏好。”

编码凝视指的是那些创造技术的人们的优先事项、偏好和偏见如何通过歧视和抹杀传播危害。Joy Buolamwini在MIT进行面部识别项目时发现了这个概念,当时她不得不戴上白色面具才能让系统检测到她的脸。这一经历促使她调查AI系统中的偏见,特别是在面部识别技术中。

主要发现:

- AI系统在对深色皮肤个体和女性的表现往往较差

- 用于训练AI模型的基准数据集经常偏向浅色皮肤的男性

- 这些偏见可能导致现实世界的后果,从错误逮捕到被拒绝的机会

Buolamwini的研究揭示了主要科技公司的面部分析系统在皮肤类型和性别上的显著准确性差异,浅色男性和深色女性之间的错误率高达34.4%。

2. 从艺术项目到全球运动:算法正义联盟的诞生

“我不会退缩。一个研究生对抗科技巨头并不是典型的路径,但为了让机器看到我,我不得不以白脸编码。”

**算法正义联盟(AJL)**源于Buolamwini在MIT的硕士论文项目。最初作为一个探索面部识别技术局限性的艺术装置,逐渐演变成一个全球性的算法问责和正义运动。

AJL的使命:

- 提高对AI偏见影响的认识

- 倡导更具包容性和公平性的AI系统

- 开发工具和方法来审计AI系统中的偏见

- 与政策制定者和行业领导者合作,推动负责任的AI开发

该组织的工作影响了政策决策、企业实践和关于AI伦理的公共话语,展示了将学术研究与激进主义和艺术相结合的力量。

3. 算法审计:揭露商业AI产品中的缺陷

“即使我的课堂项目对我不起作用?我的浅色皮肤同学似乎很喜欢使用它。当然,考虑到摄像头追踪个人的后果和大规模监控的危险,不被检测到的确可能有优势。”

算法审计是对AI系统进行系统评估,以识别不同人口群体之间的偏见和性能差异。Buolamwini的“性别阴影”项目是一个开创性的算法审计,揭示了商业性别分类系统中的显著准确性差距。

性别阴影审计的主要发现:

- 所有测试系统在深色皮肤女性上的表现最差

- 浅色男性和深色女性之间的最大准确性差距为34.4%

- 审计揭示了即使是领先科技公司的AI产品也存在重大偏见

性别阴影项目和随后的审计促使商业AI系统改进,并提高了对多样化测试数据集和严格评估方法需求的认识。

4. 具感染力的审计:人性化AI的影响

“机器能否像我一样看到我的女王们?机器能否像我们认识的那样看到我们的祖母?”

具感染力的审计通过艺术表达和个人叙述来展示算法偏见的人类影响。Buolamwini的口语作品《AI,我不是女人吗?》就是一个典型例子,展示了AI系统如何错误分类著名黑人女性的图像。

具感染力的审计的影响:

- 人性化AI偏见的后果

- 吸引学术圈以外的更广泛受众

- 激发行动和政策变革

《AI,我不是女人吗?》视频迅速走红,并在纪录片《编码偏见》中亮相,帮助提高了公众对AI偏见及其现实世界影响的认识。

5. 对抗抹杀:放大科技中被边缘化的声音

“对我的发现保持沉默不会防止伤害,因为这些系统已经在开发中。我的发声提供了考虑替代路径的机会,包括不使用。”

对抗抹杀在AI和科技中涉及积极放大被边缘化的声音并挑战现状。Buolamwini在媒体抹杀和学术门槛方面的经历突显了在AI研究和开发中多样化视角的重要性。

对抗抹杀的策略:

- 与代表性不足的研究人员和从业者合作并支持他们

- 利用媒体平台突出多样化的声音和经历

- 挑战机构和公司解决系统性偏见

Buolamwini通过纪录片《编码偏见》和她的倡导努力,帮助引起了对女性和有色人种在AI伦理和研究中贡献的关注。

6. 超越学术界:与政策制定者和公众互动

“国会会对此采取行动。”

与政策制定者互动对于将研究发现转化为现实世界的变化至关重要。Buolamwini在国会的证词和与政府机构的合作展示了研究人员对政策决策的影响。

主要政策互动:

- 在国会就面部识别技术作证

- 参与制定《AI权利法案》

- 支持地方政府对执法部门使用面部识别的监管努力

这些努力导致了对AI系统的更多审查、拟议立法和各级政府的政策变化。

7. AI开发中的包容与排除成本

“在AI系统的设计和部署中,必须考虑包容和排除的成本,并将其情境化。”

平衡AI开发中的包容和排除需要仔细考虑潜在的利益和危害。虽然多样化的数据集可以提高AI性能,但它们也可能使更广泛的监控和控制成为可能。

考虑因素:

- 提高AI准确性可以增强有益的应用(如医疗诊断)

- 更准确的面部识别也可能使大规模监控成为可能

- 将某些群体排除在数据集之外可能保护隐私,但会导致这些群体的表现不佳

Buolamwini倡导一种细致入微的方法,考虑AI系统的更广泛社会影响,而不仅仅关注技术性能指标。

8. 迈向算法正义:从研究到现实世界的变革

“我们需要法律。多年来,关于算法问责、远程生物识别技术和数据隐私的立法草案已经提出。随着对AI对我们生活影响的认识不断增加,我们需要知道我们的政府机构将保护我们的公民权利,无论技术如何发展。”

算法正义需要结合研究、倡导、政策变革和公众参与的多方面方法。Buolamwini从研究生到有影响力的AI伦理学家的旅程展示了个人推动系统性变革的潜力。

争取算法正义的关键组成部分:

- 对AI系统进行严格的研究和审计

- 公共教育和意识提升活动

- 与政策制定者和行业领导者合作

- 支持基层努力和社区组织

《AI权利法案》的发布和公众对AI伦理问题的日益关注表明了进展,但要确保AI系统以尊重人权和促进公平的方式开发和部署,仍需持续的警惕和倡导。

读者评价

《揭开AI的面纱》因其对AI偏见和伦理问题的通俗探讨而备受赞誉。读者们欣赏布拉姆维尼的个人经历和对科技世界的见解。许多人认为这本书内容丰富,发人深省,强调了解决算法偏见的重要性。一些评论者提到书中带有回忆录的风格,并希望能有更多的技术深度。总体而言,这本书被视为理解AI对社会影响的重要贡献,尽管在个人叙述和技术内容的平衡上,意见有所不同。

其他人还在读

常见问题

What's Unmasking AI about?

- Exploration of AI and Society: Unmasking AI by Joy Buolamwini examines the intersection of artificial intelligence and social justice, focusing on how AI can perpetuate biases and discrimination.

- Personal Narrative: The book combines Buolamwini's personal experiences with rigorous research, detailing her journey as a researcher and activist in the field of algorithmic justice.

- Coded Gaze Concept: A central theme is the "coded gaze," which refers to how the biases of technology creators can be embedded in AI systems, leading to harmful outcomes.

- Call to Action: Buolamwini emphasizes the need for collective action to ensure AI serves humanity equitably, advocating for algorithmic justice and diverse representation in tech development.

Why should I read Unmasking AI?

- Timely and Relevant Topic: As AI technologies become more integrated into daily life, understanding their implications is crucial. Buolamwini's insights provide a necessary critique of these systems.

- Personal and Engaging Narrative: The book combines storytelling with research, making complex topics accessible. Buolamwini's journey offers inspiration and motivation for readers.

- Empowerment Through Knowledge: Reading this book equips individuals with the knowledge to question and challenge the status quo in technology, encouraging critical thinking about societal structures.

- Insightful Perspective: It provides a unique viewpoint from a leading voice in algorithmic justice, essential for anyone interested in technology's impact on society.

What are the key takeaways of Unmasking AI?

- AI Reflects Human Bias: AI systems are not neutral; they reflect the biases of their creators, leading to real-world consequences for marginalized groups.

- Importance of Diverse Representation: Buolamwini argues for the necessity of diverse voices in technology development to ensure AI serves all communities fairly.

- Call to Action: The book urges readers to engage in conversations about AI and its societal impacts, advocating for algorithmic justice and shaping the future of technology.

- Collective Action for Change: Buolamwini emphasizes the need for a united front against harmful AI practices, encouraging participation in movements for algorithmic justice.

What are the best quotes from Unmasking AI and what do they mean?

- "The coded gaze describes the ways...": This quote highlights how biases can be embedded in AI systems, leading to discrimination against marginalized groups.

- "We cannot have racial justice...": It underscores the urgent need for ethical considerations in AI development, particularly in sensitive areas like law enforcement.

- "AI will not solve poverty...": Buolamwini emphasizes that technological solutions cannot address systemic societal issues without addressing underlying social and economic structures.

- "Your silence will not protect you.": This quote underscores the importance of speaking out against injustices, particularly in the context of AI and technology.

How does Joy Buolamwini define the "coded gaze" in Unmasking AI?

- Definition of Coded Gaze: The "coded gaze" is how technology reflects the biases of its creators, leading to harmful outcomes for marginalized communities.

- Examples of Coded Gaze: Buolamwini shares personal anecdotes, such as her experience with facial recognition technology that failed to recognize her dark-skinned face.

- Broader Implications: The concept extends beyond race and gender, encompassing various forms of discrimination, including ableism and ageism.

- Call for Critical Examination: Buolamwini calls for a critical examination of technology to ensure it serves all communities equitably.

What is algorithmic bias, as defined in Unmasking AI?

- Definition of Algorithmic Bias: It refers to the systematic and unfair discrimination that occurs when AI systems produce different outcomes for different demographic groups.

- Real-World Implications: Buolamwini's research shows how algorithmic bias can lead to misidentification and wrongful arrests, particularly for people of color.

- Need for Accountability: Addressing algorithmic bias requires transparency and accountability from tech companies, with rigorous testing and auditing of AI systems.

- Impact on Society: The book provides examples of how these biases manifest in technologies like facial recognition, affecting marginalized communities disproportionately.

What are the implications of AI technologies on marginalized communities as discussed in Unmasking AI?

- Discrimination in AI Systems: AI technologies, particularly facial recognition, can lead to discrimination against marginalized groups, often misidentifying or not recognizing individuals.

- Real-World Consequences: Instances of AI failures have resulted in wrongful arrests and other serious repercussions for individuals from marginalized communities.

- Need for Ethical AI: Buolamwini advocates for ethical AI systems that prioritize the needs and rights of all individuals, emphasizing inclusive data and diverse representation.

- Urgent Accountability: The book underscores the urgent need for accountability in AI development to prevent discrimination and harm.

How does Unmasking AI address the issue of data collection and representation?

- Critique of Data Practices: Buolamwini critiques data collection practices that prioritize convenience over inclusivity, often lacking representation of diverse populations.

- Importance of Diverse Datasets: The book emphasizes the need for datasets that accurately reflect societal diversity to prevent biased outcomes in AI systems.

- Call for Transparency: Buolamwini urges tech companies to disclose data sourcing and demographics, essential for building trust and accountability in AI technologies.

- Impact on AI Development: Without diverse representation in data, AI systems will continue to perpetuate existing inequalities, highlighting the need for change.

How does Joy Buolamwini's work contribute to the fight for algorithmic justice?

- Founding the Algorithmic Justice League: Buolamwini established the organization to raise awareness about AI bias and advocate for equitable technology.

- Research and Activism: Her work combines academic research with grassroots activism, making her a prominent figure in the movement for algorithmic justice.

- Influencing Policy: Buolamwini's advocacy has led to significant discussions around AI regulation, including calls for moratoriums on facial recognition use by law enforcement.

- Community Engagement: She emphasizes the importance of community engagement in addressing AI harms, ensuring that affected voices are heard.

What is the significance of the "Gender Shades" project mentioned in Unmasking AI?

- Research on Facial Recognition: The "Gender Shades" project examined facial recognition systems' performance across demographic groups, revealing significant accuracy disparities.

- Impact on Industry Standards: The findings influenced major tech companies to reconsider practices and improve algorithms, prompting discussions about AI ethics.

- Raising Awareness: The project catalyzed broader conversations about representation and bias in AI, highlighting the need for diverse datasets and inclusive practices.

- Influence on Policy: It has served as a foundation for advocating policy changes to address algorithmic bias and ensure ethical AI development.

How does Unmasking AI propose solutions for algorithmic bias?

- Advocacy for Algorithmic Justice: Buolamwini calls for ethical considerations in AI development, encouraging conversations about societal impacts and equitable solutions.

- Diverse Representation in Tech: The book highlights the importance of including diverse voices in technology development to ensure fair AI systems.

- Policy Recommendations: Buolamwini suggests collaboration between policymakers and tech companies to create regulations addressing algorithmic bias.

- Accountability and Transparency: Emphasizes the need for accountability and transparency in AI systems to prevent discrimination and harm.

How can individuals contribute to the movement for algorithmic justice?

- Educate Yourself and Others: Buolamwini encourages learning about AI and its societal impacts, sharing knowledge to build an informed community.

- Advocate for Change: Participate in advocacy efforts, such as supporting legislation addressing AI bias and discrimination, and engage with local organizations.

- Challenge Harmful Practices: Question and challenge AI technologies that perpetuate harm, holding companies accountable for a just technological landscape.

- Empowerment Through Action: Individuals can contribute to a more equitable future by actively participating in movements for algorithmic justice.