Principais Lições

1. Algoritmos: a base para resolver problemas com eficiência.

Um algoritmo é um conjunto de instruções para realizar uma tarefa.

Definição de algoritmos. Essencialmente, um algoritmo é um procedimento bem definido ou um conjunto de regras criadas para resolver um problema específico. Eles são os blocos fundamentais dos programas de computador, determinando como os dados são processados e manipulados para alcançar um resultado desejado. A escolha do algoritmo influencia diretamente a eficiência e o desempenho de um programa, tornando essa decisão um aspecto crucial no desenvolvimento de software.

Exemplos de algoritmos. Algoritmos não se limitam à ciência da computação; estão presentes no nosso dia a dia. Por exemplo:

- Uma receita para fazer um bolo é um algoritmo.

- As instruções para chegar de um lugar a outro de carro são um algoritmo.

- Os passos para montar um móvel também são um algoritmo.

Importância dos algoritmos. Compreender algoritmos é fundamental para programadores, pois permite escrever códigos eficientes e eficazes. Ao escolher o algoritmo adequado para uma tarefa, os desenvolvedores podem otimizar o desempenho, reduzir o consumo de recursos e melhorar a experiência do usuário.

2. Busca Binária: um prodígio em tempo logarítmico.

Na busca binária, você escolhe o número do meio e elimina metade dos números restantes a cada tentativa.

Definição da busca binária. A busca binária é um algoritmo eficiente para encontrar um valor específico dentro de uma lista ordenada. Funciona dividindo repetidamente o intervalo de busca ao meio. Se o elemento do meio for o valor desejado, a busca termina com sucesso. Caso contrário, a busca continua na metade esquerda ou direita, dependendo se o valor procurado é menor ou maior que o elemento do meio.

Complexidade em tempo logarítmico. A grande vantagem da busca binária é sua complexidade de tempo logarítmico, representada por O(log n). Isso significa que o número de passos necessários para encontrar o valor cresce de forma logarítmica conforme o tamanho da lista aumenta. Por exemplo:

- Uma lista com 1.024 elementos exige no máximo 10 passos.

- Uma lista com 1.048.576 elementos exige no máximo 20 passos.

Aplicações práticas. A busca binária é amplamente utilizada em situações onde a busca eficiente é essencial, como:

- Procurar uma palavra em um dicionário.

- Encontrar um contato em uma lista telefônica.

- Consultar dados em um índice de banco de dados ordenado.

3. Arrays vs. Listas Ligadas: escolhendo a estrutura certa.

Num array, todos os seus elementos ficam armazenados lado a lado.

Definição de arrays e listas ligadas. Arrays e listas ligadas são duas estruturas de dados fundamentais para armazenar coleções de elementos. Arrays guardam os elementos em locais de memória contíguos, enquanto listas ligadas armazenam os elementos em locais não contíguos, com cada elemento apontando para o próximo na sequência. A escolha entre arrays e listas ligadas depende das necessidades específicas da aplicação.

Vantagens dos arrays. Arrays oferecem acesso rápido e direto aos elementos, permitindo acessar qualquer elemento pelo seu índice em tempo O(1). Isso os torna ideais para aplicações que exigem buscas frequentes por elementos.

Vantagens das listas ligadas. Listas ligadas são excelentes para inserções e remoções, especialmente no meio da lista. Inserir ou remover um elemento numa lista ligada requer apenas atualizar os ponteiros dos elementos adjacentes, o que pode ser feito em tempo O(1). Por isso, são indicadas para aplicações com muitas inserções e exclusões.

4. Recursão: elegância na autorreferência.

Recursão é quando uma função chama a si mesma.

Definição de recursão. Recursão é uma técnica poderosa de programação onde uma função se chama dentro da sua própria definição. Isso permite dividir problemas complexos em subproblemas menores e semelhantes, que são resolvidos recursivamente até que se alcance um caso base.

Caso base e caso recursivo. Toda função recursiva deve conter dois elementos essenciais:

- Um caso base, que determina quando a recursão deve parar.

- Um caso recursivo, que define como a função se chama novamente com um subproblema menor.

Pilha de chamadas. Funções recursivas dependem da pilha de chamadas para controlar o estado de cada invocação. Cada vez que a função se chama, um novo quadro é adicionado à pilha, armazenando variáveis e contexto de execução. Ao atingir o caso base, a função retorna e os quadros são removidos da pilha na ordem inversa.

5. Quicksort: dividir, conquistar e ordenar com eficiência.

Quicksort é um algoritmo de ordenação.

Definição do Quicksort. Quicksort é um algoritmo popular e eficiente que utiliza o paradigma dividir para conquistar. Ele seleciona um elemento "pivô" do array e divide os demais elementos em dois subarrays, conforme sejam menores ou maiores que o pivô. Os subarrays são ordenados recursivamente, e então combinados com o pivô para formar o array final ordenado.

Dividir para conquistar. Quicksort exemplifica a estratégia dividir para conquistar, que consiste em quebrar um problema em subproblemas menores e semelhantes, resolver esses subproblemas recursivamente e depois combinar as soluções para resolver o problema original.

Desempenho médio. Quicksort tem complexidade média de tempo O(n log n), sendo um dos algoritmos de ordenação mais rápidos na prática. Contudo, no pior caso, sua complexidade pode chegar a O(n²), o que ocorre quando o pivô é escolhido de forma inadequada. Para evitar isso, é comum escolher o pivô aleatoriamente.

6. Tabelas Hash: o poder das buscas por chave-valor.

Uma tabela hash associa chaves a valores.

Definição de tabelas hash. Tabelas hash são estruturas de dados poderosas que permitem armazenar e recuperar pares chave-valor de forma eficiente. Elas utilizam uma função hash para mapear cada chave a um índice em um array, onde o valor correspondente é guardado. Isso possibilita operações de busca, inserção e remoção em tempo constante (O(1)) na média.

Funções hash. O desempenho de uma tabela hash depende muito da qualidade da função hash. Uma boa função hash distribui as chaves uniformemente pelo array, minimizando colisões, que ocorrem quando duas ou mais chaves são mapeadas para o mesmo índice.

Casos de uso. Tabelas hash são amplamente usadas em aplicações que exigem buscas rápidas por chave, como:

- Implementação de dicionários e tabelas de símbolos.

- Cache de dados para acesso rápido.

- Indexação de bancos de dados para buscas eficientes.

7. Busca em Largura: navegando redes com facilidade.

A busca em largura indica se existe um caminho de A até B.

Definição da busca em largura. A busca em largura (BFS) é um algoritmo de travessia de grafos que explora o grafo nível por nível, começando por um nó fonte. Ele visita sistematicamente todos os vizinhos do nó inicial, depois os vizinhos desses vizinhos, e assim por diante, até encontrar o nó alvo ou explorar todo o grafo.

Caminho mais curto. A BFS garante encontrar o caminho mais curto entre dois nós em um grafo não ponderado, onde o caminho mais curto é aquele com o menor número de arestas.

Filas. A BFS utiliza uma fila para controlar os nós a serem visitados. A fila assegura que os nós sejam visitados na ordem em que foram descobertos, o que é essencial para encontrar o caminho mais curto.

8. Algoritmo de Dijkstra: encontrando o caminho ponderado mais curto.

O algoritmo de Dijkstra calcula o caminho mais curto em grafos ponderados.

Definição do algoritmo de Dijkstra. O algoritmo de Dijkstra é um método de busca em grafos que resolve o problema do caminho mais curto a partir de uma fonte para todos os outros nós, em grafos com pesos não negativos nas arestas, produzindo uma árvore de caminhos mínimos.

Grafos ponderados. Diferente da busca em largura, o algoritmo de Dijkstra lida com grafos ponderados, onde cada aresta tem um valor numérico associado, representando custo ou distância.

Grafos acíclicos dirigidos. O algoritmo de Dijkstra funciona em grafos acíclicos dirigidos (DAGs), que são grafos sem ciclos e cujas arestas têm direção.

9. Algoritmos Guloso: soluções rápidas e aproximadas.

Algoritmos gulosos otimizam localmente, esperando alcançar o ótimo global.

Definição de algoritmos gulosos. Algoritmos gulosos são uma abordagem simples e intuitiva para resolver problemas, fazendo a escolha localmente ótima em cada passo, com a esperança de encontrar uma solução globalmente ótima. São usados quando encontrar a solução exata é computacionalmente caro ou inviável.

Algoritmos de aproximação. Muitas vezes, algoritmos gulosos são usados como algoritmos de aproximação, que fornecem soluções próximas do ótimo, mas que podem não ser exatamente ótimas.

Problema da cobertura de conjuntos. Um exemplo clássico onde algoritmos gulosos são úteis é o problema da cobertura de conjuntos, que consiste em encontrar o menor conjunto de subconjuntos que cubra todos os elementos de um conjunto dado.

10. Programação Dinâmica: otimizando por meio de subproblemas.

Programação dinâmica é útil quando você quer otimizar algo sob uma restrição.

Definição de programação dinâmica. Programação dinâmica é uma técnica poderosa que consiste em dividir um problema complexo em subproblemas menores e sobrepostos, resolver cada subproblema uma única vez e armazenar suas soluções em uma tabela ou memória para evitar recomputações. Essa abordagem melhora significativamente a eficiência de algoritmos para problemas com subestrutura ótima e subproblemas sobrepostos.

Problema da mochila. Um exemplo clássico resolvido por programação dinâmica é o problema da mochila, que envolve selecionar um subconjunto de itens com valor máximo que caiba em uma mochila com capacidade limitada.

Grade. Toda solução por programação dinâmica envolve uma grade. Os valores nas células geralmente representam o que se quer otimizar. Cada célula é um subproblema, então pense em como dividir seu problema em subproblemas.

11. K-Vizinhos Mais Próximos: aprendendo com os vizinhos.

KNN é usado para classificação e regressão, olhando para os k vizinhos mais próximos.

Definição de k-vizinhos mais próximos. K-vizinhos mais próximos (KNN) é um algoritmo simples e eficaz de aprendizado de máquina, usado tanto para classificação quanto para regressão. Ele funciona encontrando os k pontos de dados mais próximos de um ponto de consulta e prevendo a classe ou valor desse ponto com base na classe majoritária ou valor médio dos vizinhos.

Classificação e regressão. KNN pode ser aplicado para classificar dados em diferentes categorias ou para prever valores contínuos.

Extração de características. A extração de características é o processo de converter dados brutos em um conjunto de características numéricas que o algoritmo KNN pode usar. A escolha das características é fundamental para o desempenho do algoritmo.

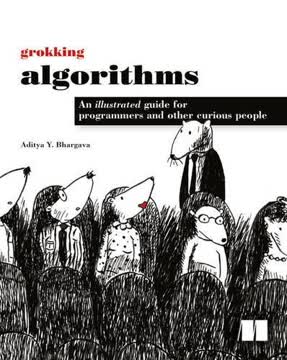

Resumo das Resenhas

Grokking Algorithms: Um Guia Ilustrado para Programadores e Outros Curiosos é amplamente elogiado pela sua abordagem acessível e visual no ensino de algoritmos. Os leitores valorizam a simplicidade do texto, as ilustrações envolventes e as explicações claras, tornando-o uma excelente introdução para iniciantes e uma boa revisão para programadores experientes. O livro aborda algoritmos fundamentais e estruturas de dados, sendo considerado por muitos agradável e fácil de compreender. Algumas críticas apontam para níveis de dificuldade irregulares, erros ocasionais e falta de profundidade em certos temas. No geral, é recomendado como um guia amigável e acessível para quem deseja entender algoritmos.

Outros Também Leram

Perguntas Frequentes

1. What’s "Grokking Algorithms" by Aditya Bhargava about?

- Beginner-friendly algorithms guide: "Grokking Algorithms" is an illustrated introduction to algorithms, designed for programmers and curious readers who want to understand how algorithms work in practice.

- Visual and example-driven: The book uses visuals, analogies, and real-world examples to explain complex concepts in a simple, engaging way.

- Covers practical algorithms: It focuses on practical algorithms and data structures that are widely used, such as binary search, sorting, hash tables, and graph algorithms.

- Step-by-step learning: Each chapter builds on the previous one, gradually introducing more advanced topics and reinforcing learning with exercises and code samples.

2. Why should I read "Grokking Algorithms" by Aditya Bhargava?

- Accessible for beginners: The book is written for anyone with basic coding knowledge, making it ideal for self-taught programmers, bootcamp students, and those new to computer science.

- Visual learning approach: If you’re a visual learner, the book’s illustrations and analogies make abstract concepts much easier to grasp.

- Practical focus: The algorithms covered are chosen for their real-world usefulness, helping you solve common programming problems efficiently.

- Foundation for further study: It provides a strong foundation for more advanced topics in algorithms, AI, databases, and machine learning.

3. What are the key takeaways from "Grokking Algorithms"?

- Understanding algorithm efficiency: You’ll learn how to analyze and compare algorithms using Big O notation, focusing on how their performance scales.

- Core data structures: The book explains arrays, linked lists, hash tables, and graphs, highlighting their strengths and weaknesses.

- Problem-solving techniques: It introduces strategies like divide-and-conquer, recursion, greedy algorithms, and dynamic programming for tackling complex problems.

- Real-world applications: Each algorithm is tied to practical use cases, such as search engines, recommendation systems, and network routing.

4. How does Aditya Bhargava explain Big O notation and algorithm performance in "Grokking Algorithms"?

- Intuitive analogies: Bhargava uses relatable examples, like searching for a name in a phone book, to illustrate the difference between linear, logarithmic, and other time complexities.

- Visual comparisons: The book includes charts and diagrams to help visualize how different algorithms scale as input size increases.

- Focus on worst-case scenarios: Big O notation is explained as a way to describe the worst-case performance of an algorithm, helping you choose the right one for your needs.

- Practical implications: Readers learn why understanding algorithm efficiency matters in real-world programming, such as optimizing for speed or memory.

5. What is the approach to teaching recursion in "Grokking Algorithms"?

- Step-by-step breakdown: Recursion is introduced with simple, relatable problems, like searching for a key in nested boxes, to demystify the concept.

- Base and recursive cases: The book emphasizes the importance of defining clear base and recursive cases to avoid infinite loops.

- Call stack visualization: Bhargava explains how the call stack works during recursion, using diagrams and analogies like a stack of sticky notes.

- Practical examples: Readers practice recursion with exercises like calculating factorials and summing lists, building confidence through repetition.

6. How does "Grokking Algorithms" explain and compare arrays, linked lists, and hash tables?

- Memory and structure: The book uses analogies (like drawers and movie seats) to explain how arrays and linked lists store data in memory.

- Strengths and weaknesses: Arrays are shown to be fast for random access but slow for insertions/deletions, while linked lists excel at inserts/deletes but are slow for random access.

- Hash tables as hybrids: Hash tables are introduced as a powerful structure combining fast lookups with flexible storage, using hash functions to map keys to values.

- Real-world use cases: Each data structure is tied to practical scenarios, such as implementing queues, phone books, and caches.

7. What are the main sorting and searching algorithms covered in "Grokking Algorithms," and how are they explained?

- Binary search: Introduced early as a fast way to search sorted lists, with clear explanations of its O(log n) efficiency.

- Selection sort: Used to teach basic sorting concepts and Big O analysis, showing why it’s less efficient (O(n²)) than more advanced algorithms.

- Quicksort: Presented as a divide-and-conquer algorithm, with step-by-step partitioning and recursion, and a discussion of average vs. worst-case performance.

- Comparison and context: The book compares these algorithms, helping readers understand when to use each and why efficiency matters.

8. How does "Grokking Algorithms" introduce graph algorithms like breadth-first search and Dijkstra’s algorithm?

- Graphs as networks: The book models real-world problems (like finding the shortest route in a city) as graphs, making the concept tangible.

- Breadth-first search (BFS): Explained as a way to find the shortest path in unweighted graphs, using queues and step-by-step exploration.

- Dijkstra’s algorithm: Introduced for finding the shortest path in weighted graphs, with clear tables and diagrams to track costs and paths.

- Practical applications: Examples include social networks, routing, and trading scenarios, showing the relevance of graph algorithms.

9. What is dynamic programming, and how is it taught in "Grokking Algorithms"?

- Breaking down hard problems: Dynamic programming is introduced as a way to solve complex problems by breaking them into overlapping subproblems.

- Grid-based solutions: The book uses grids to visualize subproblems, such as in the knapsack problem and longest common substring.

- Step-by-step filling: Readers learn to fill in grids row by row or column by column, building up to the optimal solution.

- Common pitfalls and tips: Bhargava addresses common questions, like handling dependencies and fractional items, and emphasizes when dynamic programming is appropriate.

10. How does "Grokking Algorithms" cover greedy algorithms and NP-complete problems?

- Greedy strategy explained: The book defines greedy algorithms as those that make the locally optimal choice at each step, hoping for a global optimum.

- Classic examples: Problems like classroom scheduling, the knapsack problem, and set covering are used to illustrate where greedy algorithms work and where they fall short.

- Approximation algorithms: For NP-complete problems, the book advocates for approximation via greedy methods when exact solutions are impractical.

- Recognizing NP-completeness: Readers are given tips to identify NP-complete problems and avoid wasting time seeking perfect solutions.

11. How does "Grokking Algorithms" introduce machine learning concepts like k-nearest neighbors (KNN)?

- KNN for classification: The book explains KNN as a simple algorithm for classifying items based on the majority class of their nearest neighbors.

- Feature extraction: Readers learn how to represent data (like fruit or users) as points in multi-dimensional space using relevant features.

- Regression and recommendations: KNN is also shown as a tool for regression (predicting values) and building recommendation systems, such as for movies.

- Limitations and improvements: The book discusses challenges like feature selection, normalization, and the use of cosine similarity for better results.

12. What are the best quotes from "Grokking Algorithms" by Aditya Bhargava, and what do they mean?

- "Algorithm speed isn’t measured in seconds, but in growth of the number of operations." – Emphasizes the importance of understanding scalability over raw speed.

- "Recursion may achieve a performance gain for your programmer." – Highlights that recursion can make code clearer and easier to reason about, even if not always faster.

- "Greedy algorithms optimize locally, hoping to end up with a global optimum." – Sums up the core idea behind greedy strategies and their limitations.

- "Dynamic programming is useful when you’re trying to optimize something given a constraint." – Captures when and why to use dynamic programming in problem-solving.

- "I believe you learn best when you really enjoy learning—so have fun, and run the code samples!" – Encourages hands-on practice and enjoyment as keys to mastering algorithms.